Facebook erwirtschaftet mit einem durchschnittlichen Kunden in Großbritannien nur etwa 34 Pfund pro Jahr – knapp unter 3 Pfund pro Monat (vor Kosten), was deutlich macht, dass kaum Spielraum oder Motivation für menschlichen Kundenservice oder individuelle Aufmerksamkeit besteht. Der Nutzer ist nicht der Kunde, sondern eher das Produkt, dessen Daten an Werbetreibende verkauft werden.

Die Nutzer pflegen also keine direkte Kundenbeziehung zur Plattform. Für das Netzwerk gibt es keinen direkten Anreiz, sich mehr um den Nutzer als um den Werbetreibenden zu kümmern. Unabhängig davon, wo man auf der Skala zwischen „absoluter Meinungsfreiheit“ und „Recht privater Unternehmen zur Zensur jedes Nutzers“ steht, ist bei solch geringen Gewinnmargen der Einsatz maschineller Verarbeitung zur Moderation von Beiträgen und Bearbeitung der Kundenschnittstelle unumgänglich.

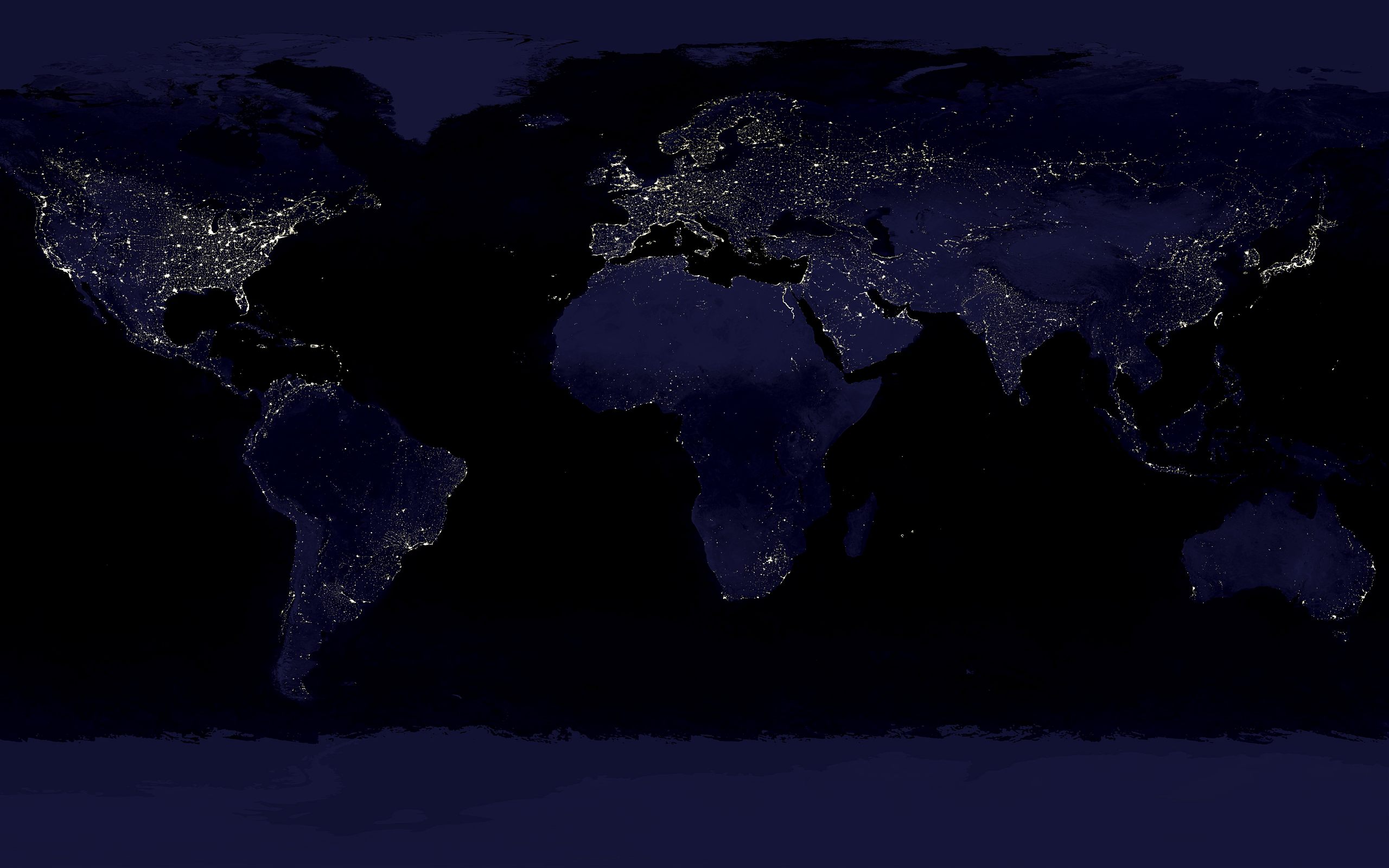

Tatsächlich werden die Kundenbearbeitungs- und Verwaltungsfunktionen, die soziale Netzwerke aktuell entwickeln, vielfältig über die reine Moderation hinaus eingesetzt. Diese automatisierte Verarbeitung findet in großem Umfang statt und wird nun auf jeden Beitrag jedes Mitglieds angewendet. 68 % der US-Wähler nutzen Facebook, im Vereinigten Königreich sind es 66 % und in Frankreich 73,2 %. Die Zahlen sind in allen demokratischen Ländern des Westens ähnlich, weshalb es entscheidend ist, dass die angewandten Regeln politisch neutral sind.

Die Macht, die in der maschinellen Verarbeitung der Beiträge jedes Nutzers liegt, ist weitreichender und tiefgreifender, als vielen bewusst sein mag. Auch wenn sie nicht direkt vorschreiben kann, was Nutzer in ihren Nachrichten schreiben, hat sie dennoch die Fähigkeit, maßgeblich zu beeinflussen, welche Nachrichten verbreitet werden.

Social-Media-Dienste sind faktisch zu öffentlichen Plätzen geworden, und es herrscht weitgehend Einigkeit darüber, dass ihre Unternehmenspolitik

Jeder Facebook-Nutzer weiß, dass das System die Reichweite einschränken kann, besonders bei politisch sensiblen Themen, manchmal sogar extrem. Nutzer können zeitweise oder dauerhaft gesperrt werden.

Die Frage ist, wie wir sicher sein können, dass soziale Medien nicht unethisch in die Politik eingreifen, angesichts ihrer Zensurmacht. Ist es verantwortungsvoll, ihnen diese Macht zu überlassen?

Ich werde darauf zurückkommen, aber offensichtlich ist das Vertrauen in diese Unternehmen unangebracht.

Die Pandemie hat vielen die Augen geöffnet, wie viel Kontrolle Social-Media-Betreiber haben. Sie setzen Regeln, die das Engagement für bevorzugte Beiträge steigern und die Followerzahl bestimmter Personen erhöhen. Im Gegenzug wird das Engagement von Nutzern, die sich gegen den Mainstream stellen, subtil verringert oder sie werden vom Dienst ausgeschlossen. Es gibt Hinweise, dass bei Facebook, Twitter und YouTube die Waage der Demokratie nicht ausgewogen ist.

Nachdem Elon Musk Twitter übernommen hatte, lud er die unabhängigen Journalisten Matt Taibbi, Bari Weiss und Michael Schellenburger ein, um in den Büros von Twitter die interne Kommunikation des Unternehmens zu untersuchen. Sie sollten erforschen, in welchem Ausmaß die früheren Eigentümer die Tweets der Nutzer zensiert hatten.

Die sogenannten Twitter Files sind das Ergebnis dieser Untersuchung. Sie legen offen, dass es weitreichende Eingriffe gab, die oft politisch motiviert waren. Das Team hinter den Twitter Files stellte fest, dass Regierungsbehörden tief in das Unternehmen eingebettet waren und sowohl US-Bürger als auch Bürger anderer Länder überwacht und zensiert haben. Zudem wurde enthüllt, dass Regierungsbehörden regelmäßig und nachdrücklich Zensurmaßnahmen gefordert haben. Es wurde auch aufgedeckt, dass ähnliche Eingriffe bei anderen sozialen Netzwerken wie Facebook stattgefunden haben.

Seit dem Bekanntwerden der Twitter Files, die eine solche Einmischung belegen, ist jedoch eine neue und möglicherweise noch größere Bedrohung entstanden.

KI.

Es gab eine Zeit, in der Algorithmen das Hauptdiskussionsthema unter digitalen Vermarktern waren. Da auf der Ebene der einzelnen Beiträge kein Raum für menschliche Eingriffe bestand, kamen Algorithmen zum Einsatz.

Zu Beginn waren sie ziemlich einfach, ähnlich den Gleichungen, die wir im Schulunterricht gelernt haben, und somit relativ leicht zu berechnen. Googles Aufstieg basierte auf einer simplen, aber brillanten Idee: das Zählen von externen Links zu einer Webseite als Indikator für deren Relevanz.

Mittlerweile haben komplexere Modelle des maschinellen Lernens die Algorithmen abgelöst. Diese basieren zwar immer noch auf Algorithmen, werden jedoch automatisch generiert und sind so komplex, dass jeder Versuch, sie zu entschlüsseln, zum Scheitern verurteilt ist. Deshalb konzentrieren wir uns darauf, was sie leisten können, welche wichtigen Aspekte sie erkennen, anstatt zu verstehen, wie der Code im Detail funktioniert.

Jetzt sind wir in die dritte Generation der Technologie vorgedrungen. Maschinelles Lernen hat sich zur Entwicklung von Large Language Models (LLMs) oder allgemeiner ausgedrückt, zur Künstlichen Intelligenz (KI) weiterentwickelt. Mit dieser neuesten Entwicklung haben Unternehmen immense und beängstigende neue Möglichkeiten für Macht und Kontrolle erlangt.

Die Entwicklung von LLMs setzt ein umfangreiches Training voraus. Durch diese Ausbildung erhalten sie spezifische Fähigkeiten und können auch Vorurteile entwickeln. Ziel des Trainings ist es, Lücken zu schließen, damit die LLMs nahtlos mit den Grundlagen menschlicher Konzepte und Sprache interagieren können. Das Besondere an LLMs ist, dass wir uns mit ihnen unterhalten können und die Konversation natürlich, flüssig sowie grammatisch und inhaltlich vollständig wirkt. Im Idealfall benimmt sich ein LLM wie ein gebildeter englischer Butler: höflich, informativ und korrekt, ohne unhöflich zu sein. Die Ausbildung ermöglicht es dem LLM auch, sich auf bestimmte Bereiche zu spezialisieren.

In Bezug auf soziale Medien – wo die erschreckenden Ausmaße ihrer Macht offensichtlich werden – dienen LLMs als Wächter, um die Inhaltsmoderation durchzuführen.

Metas Llama Guard ist ein Beispiel dafür, ausgebildet nicht nur zur Moderation, sondern auch zur Meldung von Nutzern. Diese Meldefunktion umfasst nicht nur die Möglichkeit, Berichte zu erstatten, sondern auch, durch diese Daten Einfluss zu nehmen und Vorschläge für und über den Nutzer zu generieren. Wenn ich von Vorschlägen spreche, bedeutet das, dass ein LLM nicht nur offensichtliche Empfehlungen aussprechen kann, die der Nutzer vielleicht begrüßt, sondern auch subtilere, unbewusste Vorschläge, die manipulativ sein und auf Kontrolle zielen können.

Bisher gibt es keine gesammelten Beweise dafür, dass LLMs auf diese Weise eingesetzt werden; zumindest sind mir keine bekannt. Doch die Möglichkeit besteht definitiv, und wenn vergangenes Verhalten ein Indikator für zukünftige Entwicklungen ist, wird diese Fähigkeit wahrscheinlich genutzt werden.

Man betrachte nur die 2006 ausgestrahlte Episode von Derren Browns Fernsehshow „Derren Brown: The Heist“, in der er eine Gruppe von Menschen überzeugt, einen Banküberfall zu begehen, um zu sehen, wie wirkungsvoll und mächtig Suggestion sein kann. Derren Brown ist ein Bühnenhypnotiseur und Mentalist, der die Kraft der Suggestion gegenüber Hypnose betont – die meisten seiner Shows beinhalten keine Hypnose. Mit reiner Suggestion veranlasst er Menschen dazu, außergewöhnliche Dinge zu tun.

Suggestionen à la Derren Brown sind wirksam, weil das menschliche Gehirn tatsächlich weniger flexibel und linearer ist, als wir annehmen. Bewusstsein ist eine wertvolle Ressource, und viele unserer regelmäßigen Handlungen werden zur Gewohnheit, sodass wir sie unbewusst ausführen können. So bleibt unser Bewusstsein für die Bereiche frei, in denen es am meisten benötigt wird.

Aus Gewohnheit schalten wir im Auto den Gang, ohne darüber nachzudenken. Und das Spiel, bei dem man in kurzer Zeit eine Liste von Dingen, wie Länder, die mit ‘A’ enden, nennen muss, zeigt, wie schwierig es sein kann, unter Druck kreativ zu denken oder sich bewusst an etwas zu erinnern. Oft ist das Gehirn nicht so gut darin, kreativ zu denken oder sich schnell und bewusst an etwas zu erinnern.

Wenn Ihnen jemand, mit dem Sie kurz vor dem Spiel gesprochen haben, von seinem Urlaub in Kenia berichtet, wird Kenia wahrscheinlich Ihre erste Assoziation sein. Diese Verknüpfung geschieht automatisch, ob wir es wollen oder nicht.

So funktioniert unser Gehirn. Werden Informationen zum richtigen Zeitpunkt auf die richtige Weise präsentiert, ist es sehr wahrscheinlich, dass ein Vorschlag befolgt wird. Derren Brown kennt sich damit aus und nutzt diese Tatsache meisterhaft.

Suchmaschinen und soziale Netzwerke haben eine enorme Macht, Verhalten durch subtile Hinweise zu steuern. Es gibt Beweise, dass Facebook und Google dies bereits praktiziert haben. Dr. Robert Epstein, Professor und Forscher, hat Google dabei ertappt, wie es das Feld für Suchvorschläge manipuliert, das unter dem Eingabefeld für Suchanfragen erscheint. Die Angelegenheit wurde noch brisanter, als offenbar wurde, dass Google sich der Unethik seiner Experimente bewusst war. Ich werde hier nicht ins Detail gehen, aber die Geschichte ist an sich sehr aufschlussreich.

Nutzer sind in einem besonders vertrauensvollen und aufnahmebereiten mentalen Zustand, wenn sie die Funktion der vorgeschlagenen Links von Google verwenden. Sie bemerken oft nicht, dass die Ergebnisse Handlungs- und zwingende Vorschläge enthalten, die nicht unbedingt die beste Antwort auf ihre Suchanfrage darstellen, sondern darauf abzielen, die nachfolgenden Aktionen des Nutzers zu steuern.

Bei Beiträgen in sozialen Medien ist die Verwendung von Vorschlägen oft viel subtiler, was ihre Erkennung und Abwehr erschwert. Die LLM-Analyse der Nutzerbeitragsdatenbank kann verwandte Beiträge enthüllen, die zu Handlungen anregen. Das Netzwerk kann sich die Tatsache zunutze machen, dass es Zugang zu Millionen von Nutzernachrichten hat, einschließlich solcher, die bevorzugte Ergebnisse nahelegen. Diese Nachrichten können ausgewählt und in den Feeds der Nutzer bevorzugt dargestellt werden.

Die Moderation von Inhalten ist unerlässlich, um mit inakzeptabler Sprache und asozialem Verhalten umzugehen. Es existiert jedoch eine große Grauzone, in der unerwünschte Meinungen als „Hassrede“ klassifiziert werden können. In dieser Grauzone hat das soziale Netzwerk viel Spielraum, um in den Bereich der persönlichen Politik und freien Meinungsäußerung einzugreifen.

Der Ausdruck “Hassrede” war ein wirksames Instrument, um den Gebrauch des Verbots-Hammers zu legitimieren. Doch nun besteht die Sorge, dass mit dem Einsatz von LLMs ein bedeutender historischer Meilenstein fast unbemerkt überschritten wurde, welcher eine völlig neue Ebene von Einschränkungen und Bedrohungen für die Kommunikationsfreiheit der Nutzer darstellt. Dieser Meilenstein bedeutet, dass LLMs nun dazu verwendet werden, menschliches Verhalten zu lenken, statt dass es andersherum ist. Die Überschreitung dieses Meilensteins blieb weitgehend unbeachtet, da wir schon zuvor einfachere Algorithmen hatten, die diese Aufgabe übernahmen, allerdings im Verborgenen.

Die Nutzer werden sich dessen erst bewusst, wenn sie direkt davon betroffen sind. Es gibt jedoch viele Gründe zu der Annahme, dass wir in der Zukunft auf diesen Moment zurückblicken und erkennen werden, dass dieser Meilenstein ein kritischer Punkt war, nach dem eine Art “Sky-Net”-ähnliche Zukunft unvermeidlich wurde.

Erst kürzlich kündigte der britische Premierminister Keir Starmer eine Polizeiinitiative an, soziale Medien zu nutzen, um Personen zu identifizieren, die an der Unterdrückung öffentlicher Unruhen beteiligt sind. Dies zeigt, wie die automatisierte Berichterstattung durch LLMs über soziale Medien hinaus im Rahmen der Strafverfolgung Anwendung finden kann.

Details darüber, wie die Überwachung umgesetzt werden soll, sind noch nicht bekannt, doch aufgrund der Erfahrungen mit Technologieprojekt-Präsentationen kann man davon ausgehen, dass die Regierung eine Reihe von Technologiefirmen hat, die Lösungen anbieten werden. Es ist sehr wahrscheinlich, dass LLMs als wesentlicher Bestandteil in fast allen diesen Projekten vorgestellt werden.

Es wurde festgestellt, dass soziale Medien geschlossen und proprietär sind, was die Entstehung neuer Medienmachtstrukturen begünstigt hat. Es ist bekannt, dass die Betreiber sozialer Netzwerke die Möglichkeit haben, die Verbreitung eines Beitrags zu fördern oder zu hemmen, und dass LLMs (Künstliche Intelligenz) nun Überwachungs- und Berichtsfunktionen eingeführt haben, die wahrscheinlich auf die reale Welt ausgedehnt werden. Die Twitter-Akten zeigen, dass Social-Media-Unternehmen während der Pandemie bereit waren, mit Regierungsbehörden zusammenzuarbeiten, um unerwünschte Nachrichten zu zensieren und zu unterdrücken, selbst wenn dies bedeutete, gegen das Gesetz zu verstoßen.

Quelle: Fascism 2.0 – The Changing Face Of Social-Media Censorship

Werden Sie Teil unserer Community und unterstützen Sie uns! Sie können uns in den Sozialen Netzwerken am besten auf Telegram oder auf X oder Facebook folgen, um unsere Inhalte zu empfangen. Oder noch besser melden Sie sich für unseren Newsletter an, um die Neuigkeiten des Tages zu erhalten.

Gerne können Sie auch Premium-Mitglied werden oder uns durch eine wirklich hilfreiche Spende unterstützen. Herzlichen Dank im voraus!

Abonnieren Sie unseren Newsletter